Investigación alerta sobre posibles riesgos para la ciudadanía por el uso de IA en políticas públicas en Latinoamérica

Por Juan Manuel García, coordinador de Investigación de Derechos Digitales

La Inteligencia Artificial ya forma parte de la batería de herramientas a disposición de la función pública para la planificación e implementación de políticas públicas. En los estados de América Latina la implementación de tecnologías basadas en IA aumentó notablemente, principalmente a partir de la masificación del uso de IA generativa a finales de 2022. Además, la pandemia de COVID-19 presentó una situación excepcional que intensificó el uso de tecnología como instrumento de gestión de trámites y servicios, pero también de políticas nodales para la protección social.

Este tipo de herramientas son implementadas para tomar decisiones relativas a, por ejemplo, qué sector poblacional priorizar sobre otro para determinada política; o qué personas pueden, potencialmente, requerir más acompañamiento estatal que otras en determinada situación, entre otros ejemplos. En este sentido, surgen inquietudes respecto de cuáles son las implicancias para el ejercicio de derechos fundamentales del uso de estas tecnologías.

Con ese horizonte, Derechos Digitales coordina, desde 2019, el proyecto Inteligencia Artificial e Inclusión, que busca responder a la pregunta sobre cómo están implementando los gobiernos de América Latina la IA y cuáles son sus impactos en el desarrollo, la inclusión y los derechos humanos. El proyecto lleva publicados 10 estudios de caso, que analizan el uso de esta tecnología en ámbitos sensibles de la administración pública, como las áreas de empleo, protección social, seguridad pública, educación y gestión de trámites, además de usos en la administración de justicia. Los informes fueron realizados por investigadoras con trayectoria en estudios de tecnología desde una perspectiva de derechos, pertenecientes a organizaciones de la sociedad civil y la academia.

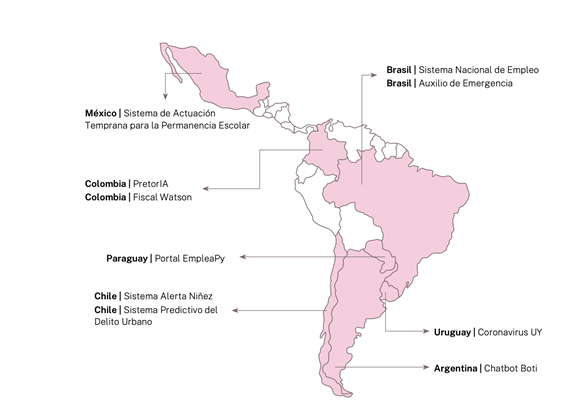

En Brasil, fueron analizados dos casos. Por un lado, la utilización de IA en el Sistema Nacional de Empleo, con el objetivo de facilitar la reubicación de profesionales sin empleo en el mercado laboral. También se realizó un estudio del programa de protección social Auxilio de Emergencia, implementado durante la pandemia.

En Chile se investigó el Sistema Alerta Niñez, que busca estimar y predecir el nivel de riesgo de niñas, niños y adolescentes de sufrir alguna vulneración en sus derechos en el futuro. En ese mismo país, fue desarrollado un análisis sobre el Sistema Predictivo del Delito Urbano.

En Colombia fueron analizados dos casos en el ámbito de la justicia. Primero, el caso de PretorIA, un proyecto de la Corte Constitucional que busca hacer más eficiente el proceso de selección de casos de tutela judicial de derechos fundamentales. El segundo caso se centró en la iniciativa llamada Fiscal Watson, donde se implementó el sistema de IA IBM Watson en la Fiscalía General de la República.

Los cuatro casos restantes pertenecen a investigaciones realizadas en Uruguay, Argentina, México y Paraguay.

En Uruguay se analizó Coronavirus UY, una aplicación móvil gratuita utilizada durante la pandemia de Covid-19. En Argentina se realizó una investigación sobre el sistema ChatBot Boti, que funciona como un asistente automático implementado por el Gobierno de la Ciudad de Buenos Aires para la autogestión de trámites en línea. En México fue analizado el Sistema de Actuación Temprana para la Permanencia Escolar que consiste en un algoritmo de aprendizaje automático para predecir la probabilidad de que las y los estudiantes de escuelas medias abandonen sus estudios, en el estado de Guanajuato. Por último, en Paraguay fue analizado el caso del Portal EmpleaPy, destinado a la gestión de oferta y búsqueda laboral, que implementa algoritmos para la conexión entre oferta y demanda.

La metodología de análisis utilizada en los estudios de caso fue desarrollada por Derechos Digitales desde una perspectiva multidimensional, con un enfoque sociotécnico. La investigación enfrentó desafíos comunes, como la falta de información disponible y las dificultades para acceder a fuentes oficiales. No obstante, permitió generar un análisis riguroso sobre la implementación de la IA en el ámbito estatal y sus implicaciones para los derechos fundamentales.

Conclusiones principales

El conjunto de las investigaciones desarrolladas por Derechos Digitales con organizaciones de América Latina, demuestra que el uso de esta tecnología en la implementación de políticas públicas, sin las garantías adecuadas, puede afectar derechos fundamentales como la privacidad, el acceso a la información y la equidad en la toma de decisiones estatales. Más allá de la eficiencia administrativa, este escenario manifiesta la urgencia de establecer marcos normativos claros y mecanismos de control democrático.

Los casos analizados aportan evidencia sobre cómo estas tecnologías pueden reforzar desigualdades y afectar derechos como la privacidad, o incluso limitar el acceso a beneficios sociales, especialmente cuando se implementan sin transparencia, supervisión humana adecuada o mecanismos de control para la rendición de cuentas. Vamos a desglosar un poco mejor estas preocupaciones.

Primero, los estudios muestran una falta de marcos normativos adecuados para la implementación de estas tecnologías. Si bien en algunos países se notan avances, aún queda mucho por trabajar.

En cuanto al acceso a la información pública, observamos un problema persistente, que atraviesa en mayor o menor medida todos los casos analizados. Se trata de la ausencia de información publicada de antemano por los gobiernos, lo que implicó esfuerzos por parte de las investigadoras para la recopilación de datos, a partir de entrevistas, pedidos de acceso a la información y consulta a portales de transparencia. Estos esfuerzos no siempre llegaron a buen puerto, dado que fueron frecuentes las respuestas incompletas a los pedidos de acceso, así como las negativas a brindar entrevistas por parte de funcionarias de gobierno.

Por otro lado, los estudios de caso evidenciaron falencias en materia de protección de datos personales. Por ejemplo, en Chile, el Sistema Alerta Niñez maneja datos sensibles de niños, niñas y adolescentes los cuales requieren de una protección reforzada debido a la falta de un consentimiento informado claro, lo que ha generado cuestionamientos sobre su adecuación a los estándares internacionales de privacidad. En Colombia, aunque el sistema PretorIA no procesa datos personales sensibles, su impacto en la legitimidad del proceso judicial resalta la necesidad de una supervisión rigurosa. En Uruguay, la aplicación Coronavirus UY centralizó datos de salud sin requerir consentimiento debido a la emergencia sanitaria, lo que expuso riesgos de uso excesivo de información delicada. Estos casos reflejan la urgencia de fortalecer los marcos de protección de datos en el uso estatal de la IA.

En este contexto donde la implementación de estas tecnologías suponía un riesgo efectivo para el ejercicio de derechos, el rol de los organismos de control fue clave en los casos donde intervinieron. Un ejemplo ilustrativo es la intervención de la Defensoría del Pueblo de Brasil en el marco del caso Auxilio de Emergencia, una política de asistencia social, donde las deficiencias en la actualización de las bases de datos utilizadas por el algoritmo para determinar la elegibilidad de la población beneficiaria causaron perjuicios a cientos de personas que intentaron acceder a este programa y se vieron impedidas. La Defensoría sirvió de intermediaria entre la justicia y la gran cantidad de demandas presentadas por la ciudadanía, que se había visto privada del beneficio.

Otro punto de alerta es la continua ausencia de espacios para una participación significativa, que garantice diversidad e inclusión de las múltiples partes interesadas, no solo en el marco de implementación de políticas, impulsadas por los distintos poderes del Estado sino también en los incipientes espacios de regulación.

De este modo, se evidencia la persistencia de problemáticas relacionadas con la protección de datos personales, el acceso a la información pública y la falta de espacios de participación significativa en la implementación de IA en la función pública. Desde Derechos Digitales, consideramos prioritaria la incorporación de una perspectiva de derechos humanos en todos los procesos relacionados con la regulación de la inteligencia artificial, ya sea a través de iniciativas del Poder Ejecutivo o de los Parlamentos de la región, con el objetivo de promover un uso responsable e inclusivo de estas tecnologías en la gestión gubernamental; que incluya limitaciones claras para su uso.

Para acceder al informe completo y los estudios de caso: “Inteligencia Artificial en el Estado: estudio colectivo sobre experiencias y riesgos para los Derechos Humanos”